'이용자 중심·위험예방·지속가능성' 3대 원칙…검증·책임 등 9개 요건

서울디지털재단은 지자체 최초로 ‘서울시 생성형 인공지능(AI) 윤리 가이드라인’을 13일 발표했다.

서울시 생성형 AI 윤리 가이드라인은 정부의 디지털 권리장전 제정과 분야별 윤리 가이드라인을 마련한다는 정부 정책의 기조를 이어받아 마련됐다.

이번 가이드라인은 이용자·운영자·개발자가 생성형 AI를 안전하게 활용할 수 있게 자율적으로 준수할 수 있는 규범을 제시하는 것을 목적으로 한다.

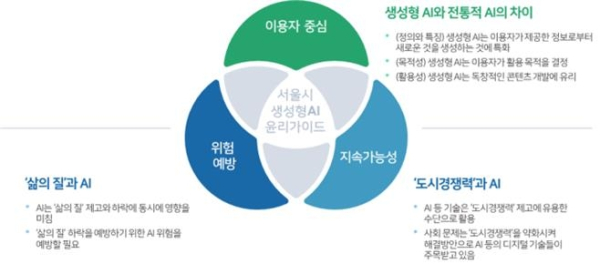

산·학·연 전문가의 의견을 여러 차례 수렴해 윤리 가이드라인 추진 방향과 3대 기본원칙(이용자 중심·위험예방·지속가능성)을 도출했고 이를 바탕으로 9대 핵심 요건을 제시했다.

9대 핵심 요건은 이용자의 검증 역량, 책임성, 데이터 권리와 책임, 사용가능성 확보, AI 학습데이터 안전성, AI 윤리 소양, 공공성, 생태적 지속가능성, 보안성이다.

이해관계자가 준수해야 할 핵심 요건별 위험요건과 실제 사례, 주의사항도 제시했다.

강요식 서울디지털재단 이사장은 "생성형 AI가 널리 퍼지면서 가짜뉴스, 개인정보 침해 등 위험 우려도 커지는 상황"이라며 "시민의 안전을 위해 지자체 최초로 발표한 생성형 AI 윤리 가이드라인을 통해 시민이 안전하고 편리하게 AI를 활용하기를 기대한다"고 말했다.

박상혁 기자

mijeong@womennews.co.kr